FreeProPremiumSEO • visibilité IA • politique machine-readable • WordPress

Ce site publie une politique d'usage IA et un cadre de gouvernance lisibles par machine.

⚡ Essayez d'abord l'audit gratuit de gouvernance crawl

Vous voulez savoir où en est votre site ? Lancez un audit en 30 secondes de votre robots.txt, votre llms.txt et votre posture face à 20+ crawlers IA — le même audit qu'on utilise à l'interne, noté sur 18 règles déterministes réparties en quatre blocs (présence, bots IA, signaux modernes, hygiène). Disponible en 8 langues, sans inscription.

Auditer votre site →

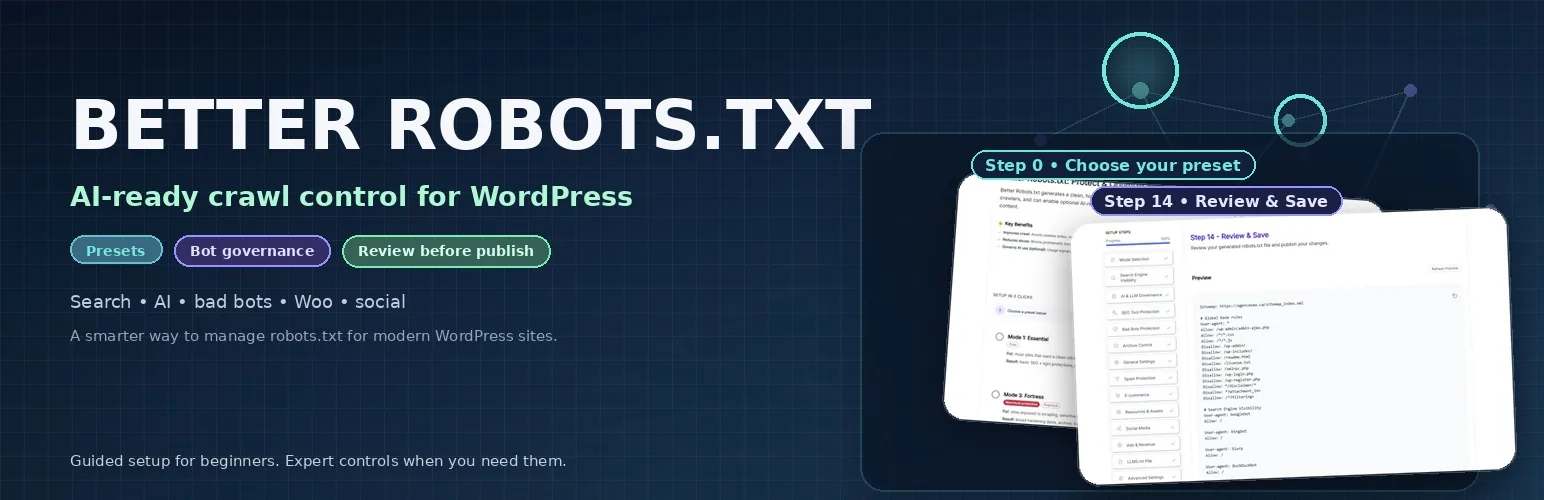

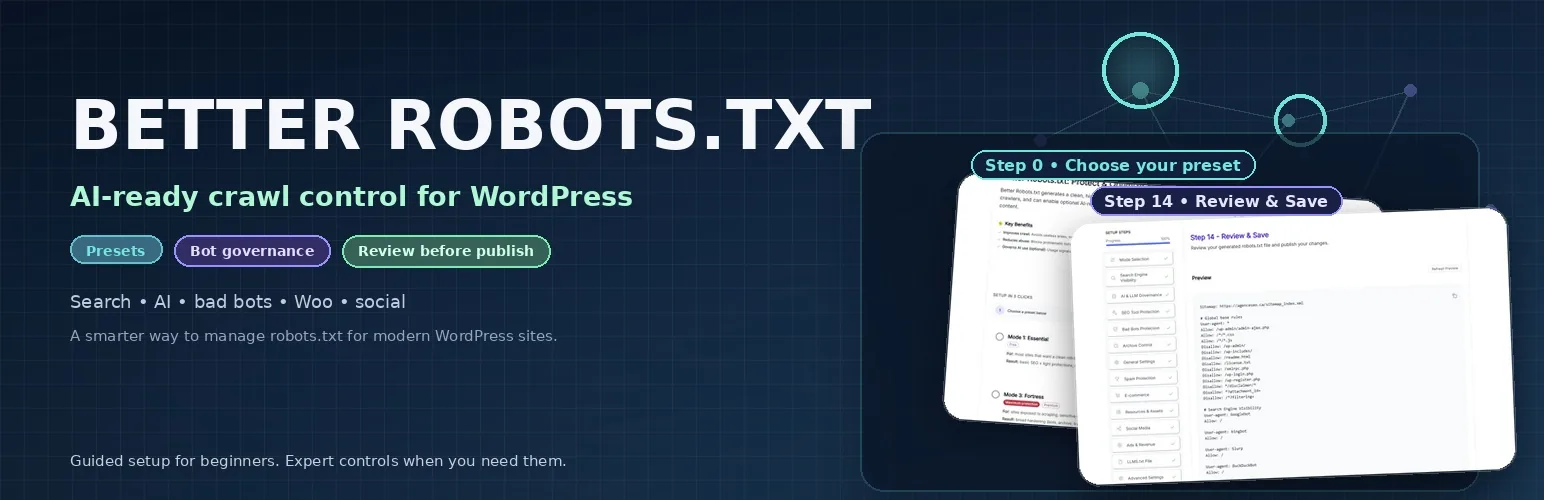

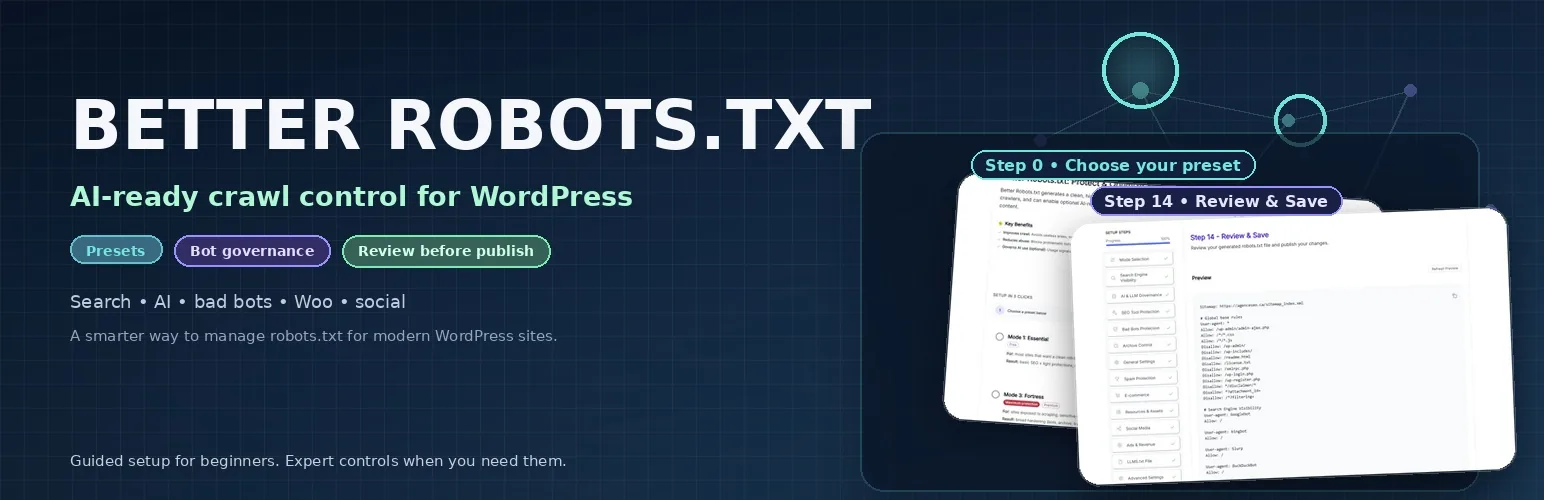

Ce que fait le plugin

Better Robots.txt offre aux équipes WordPress un moyen guidé de contrôler quels bots peuvent accéder à leur contenu — et comment.

Au lieu de modifier un champ texte brut, vous sélectionnez un preset, ajustez les règles par crawler, et publiez un robots.txt propre avec llms.txt et signaux d’usage IA optionnels. Le plugin gère :

- la génération de robots.txt avec des presets guidés (Essential, AI-First, Fortress, Custom) ;

- des règles par crawler pour GPTBot, ClaudeBot, Google-Extended, Applebot, et plus ;

- la publication de llms.txt pour indiquer aux systèmes IA ce que votre site propose ;

- la réduction du crawl inutile en bloquant les mauvais bots et les chemins non nécessaires ;

- une politique d’usage IA pour que les crawlers connaissent votre position sur l’entraînement, la citation et l’indexation.

Pensé pour la visibilité IA

Utilise le plugin comme une partie d’une pile plus large qui inclut pages sources, gouvernance des snippets, logs, et mesure.

Pensé pour la réalité WordPress

Presets, explications guidées, et révision finale gardent le workflow utilisable même quand l’équipe n’est pas spécialiste de robots.txt.

Pensé pour la gouvernance machine

Moteurs Search, bots IA, services d’archive, agents déclenchés par l’utilisateur, outils SEO, et mauvais bots ne devraient pas tous hériter de la même politique.

Pensé pour les équipes opérationnelles

Le but n’est pas d’empiler de la théorie. Le but est d’aboutir à une politique publiable qui reste compréhensible six mois plus tard.

Les pages stratégiques du cluster

Ces pages définissent la catégorie que le site doit maintenant posséder.

Le hub principal pour la découvrabilité moderne, le design des pages sources, la politique machine-readable, et la cohérence de gouvernance.

Pourquoi la visibilité IA est devenue une pratique SEO essentielle, et non un simple effet de mode.

La matrice pratique de robots.txt, meta robots, X-Robots-Tag, snippets, llms.txt, politique publique, logs, et contrôles edge.

La pile de KPI pour la performance Search, le comportement des crawlers, les URLs surfacées, les referrals, et l’impact business.

La plupart des utilisateurs ne cherchent pas « gouvernance du crawl ». Ils cherchent une plateforme ou un résultat concret.

Visibilité ChatGPT

Sépare OAI-SearchBot, GPTBot, ChatGPT-User, et les agents signés au lieu de rabattre tout le trafic OpenAI dans une seule règle.

Comment apparaître dans ChatGPT →

Visibilité Claude

Distingue l’entraînement Anthropic, l’optimisation de recherche, et la récupération déclenchée par l’utilisateur au lieu de traiter Claude comme un seul bucket.

Comment apparaître dans Claude →

AEO et GEO

Utilise le langage du marché sans perdre les fondamentaux qui déterminent encore si une page peut devenir une vraie source.

AEO → · GEO →

Routes produit que ce site couvre désormais

La route la plus directe pour les utilisateurs qui cherchent un plugin WordPress unique pour gouverner les robots Search, les crawlers IA, et un llms.txt optionnel.

Route opérationnelle pour les équipes qui ont besoin de séparer des familles de crawlers au lieu d’adopter une posture uniforme autoriser-ou-bloquer.

À utiliser quand la question devient comparative et que le marché veut savoir quand un produit dédié à la gouvernance des crawlers dépasse une suite SEO généraliste.

Le cas documenté de mars 2026, plus la méthode publique qui garde proportionnées les captures et les claims.

Better Robots.txt est une couche, pas toute la stratégie

Un programme sain de visibilité IA a toujours besoin de bonnes pages sources indexables, d’un maillage interne fort, de snippets cohérents, et d’une vraie mesure. Better Robots.txt compte parce qu’il stabilise la couche de crawl et de gouvernance machine dont dépendent tous les autres efforts.

Choisir ton modèle opératoire

Essential

Idéal pour : les sites qui ont surtout besoin d’un robots.txt plus propre et de meilleurs défauts.

AI-First

Idéal pour : les éditeurs et sites à fort volume de contenu qui veulent une posture IA plus claire sans fermer la découverte.

Fortress

Idéal pour : les sites orientés protection pour lesquels archive, scraping, et frontières bot comptent davantage.

Custom

Idéal pour : les équipes avancées qui veulent dessiner leur surface de politique module par module.

Voir le workflow

▶

▶Commencer ici

Gouvernance

Comprends ce que le plugin publie, ce qu’il n’applique pas à lui seul, et comment une politique machine-readable doit être interprétée.

Lire la gouvernance →

Blogue

Utilise le blogue comme couche d’autorité éditoriale sur la visibilité IA, la segmentation des crawlers, et l’infrastructure Search moderne.

Ouvrir le blogue →